更新iOS16之後,有兩個我玩得有點欲罷不能,一直想找素材來玩的功能,一個是用表情符號製作新的鎖定桌布,二是長按去背的功能。前者完全是讓你發揮惡搞創意用,很魔幻的東西

,後者則有實質性的功能,而且在很多素材上試用後,發現它的辨識準確度,好到一個讓人小驚訝的程度,是個非~常~可用的功能,而且不限專業用途,去背提取後也可以貼到LINE..等很多第三方App,一般人會用到的機會也不少。

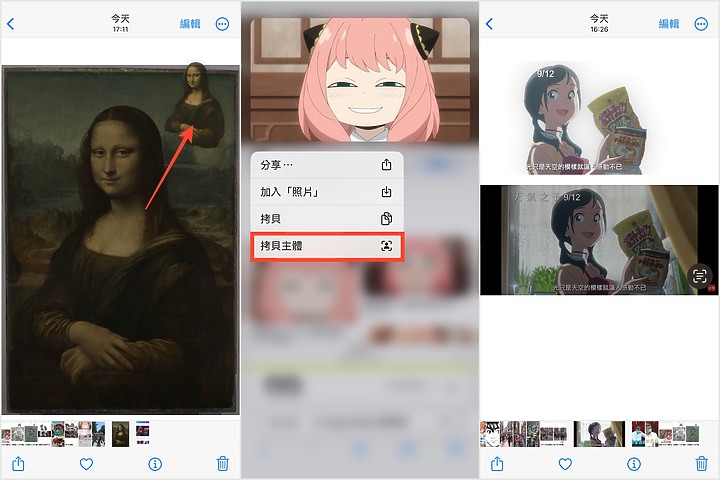

,後者則有實質性的功能,而且在很多素材上試用後,發現它的辨識準確度,好到一個讓人小驚訝的程度,是個非~常~可用的功能,而且不限專業用途,去背提取後也可以貼到LINE..等很多第三方App,一般人會用到的機會也不少。這功能目前沒有名稱,選單裡顯示的是「拷貝主體」,我們底下就這樣稱呼它吧。

是什麼?怎麼操作?

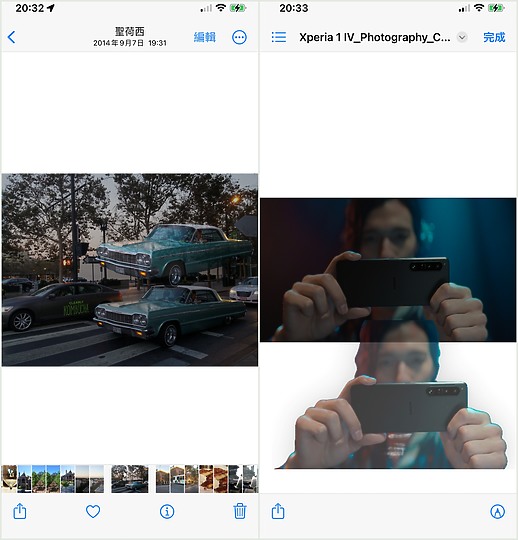

它是iOS16裡一個新功能,長按圖片後,它會自動辨識圖片裡的主體,去背出來,讓你單獨拷貝貼上,或拖曳到其他App上使用,基本上就是一指去背啦。基本是這樣~看到圖片、長按,就行了。

這個過程有使用到機器學習訓練的圖片辨識模型,以及CoreML、神經網路引擎...等工具,可以在非常短的時間裡辨識出照片裡那個東西是主體,範圍到哪裡,讓你提取出來,發表會上有提到它是在幾毫秒內執行400億次運算來達成的。

另外就如其他機器學習功能一樣,這些都是在裝置內AI學習,對隱私也較有保障。

對人的眼睛來說這件事情很簡單,但對程式來說卻不一定,比方有個和背景顏色相近的東西,有沒有能力辨識出來,就要看模型訓練的程度,以及運算能力了。

也因為計算能力有關,這功能只會出現在A12 Bionic之後的iPhone、iPad上,也就是iPhone XS之後機種、以及2018年以後的iPad Pro、2019年以後的iPad Air(第三代)、iPad mini(第五代),以及2020年以後的iPad(第八代)。

那些地方可以拷貝主體?

只要是圖片就可以提取,重點是在哪裡出現的圖片。目前試到,在照片、檔案、Safari、郵件(快速查看)...這些App裡的圖片,都可以拷貝主體,至於其他App裡、影片,就是擷取螢幕,或是把圖片另存到「照片」App裡,就可以長按提取了。

都抓得很好嗎?

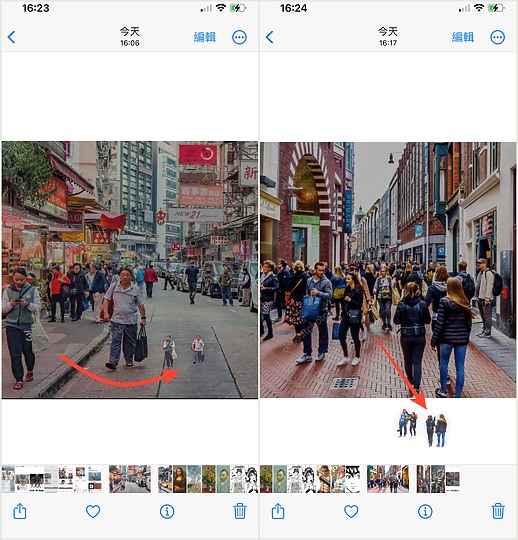

現階段當然不可能所有照片都抓得很如你意,但準確率還是很不錯的。大家應該也猜得出來,的確是一些邊界線條不明顯、很細、與背景紋路相近的,會比較不好抓。

或者像拍攝室內裝潢全景、整片大風景...這種畫面裡沒特別把哪個物件當作主體的,也較無法執行。

至於主體是人、動物、建築或是食物...等哪種類型,倒是比較沒關係,但發現會偏向以人,跟照片中較大的那個東西為主,比方照片裡同時有把椅子跟一個人,會抓出人,抓不了那把椅子的去背。

跟照片背景有沒有景深,也沒那麼絕對的關係,背景沒景深的主體還是抓得出來,比方左邊那張很普通的路邊照,也有像右邊那種人臉已經是散景的一部份了,但因為照片內容單純,依然被認定為主體。

另外本以為背景雜亂,或是人群的照片可能很難提取,但好像也不一定,只要裡面有較大,或是,看起來可以獨立像主體的東西,還是有機會提取出來。但有可能他判斷的主體,與你覺得的不一樣。

看起來還是人體/ 物件先決,加上一些綜合判斷來決定。

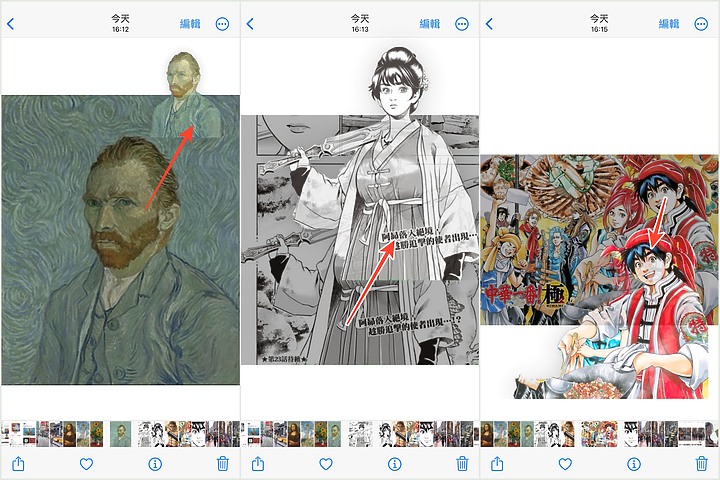

試用時覺得很好玩的是,一些動漫、名畫、影片截圖,也可以抓出當中的人,感覺以後要作梗圖或什麼創作,就方便多了,而且不會去背的一般人更方便。

但當然,使用時要注意版權的問題。

可以用在哪裡?

提取出的就是一張透明背景的去背圖,所以你可以用在任何可以貼上、傳送圖片的程式。比方拉到LINE或訊息傳送。

或是貼到圖片編輯的App。這裡我是貼到《Canva》這個程式去做海報設計。

或是從網頁拷貝/ 貼上圖片製作文件,這裡是在Safari上隨便找一張圖,長按快速查看圖片時,直接選擇拷貝主體,貼到Keynote上,這個好方便啊。

當然不只這些應用,依照大家的使用習慣,可以去想想這功能可以用在哪件事情上,如果可以的話,歡迎在底下分享腦力激盪一下。

但目前用起來,覺得不足的地方是:提取後就要馬上用,還沒有單純儲存成一張去背圖,先收集起來以後再用的設計。

另外目前還缺少手動加減選取範圍的步驟,來補足自動判斷摳圖不準的時候。

不過目前這功能還在很初期的開發版,它後面會有什麼變化,還有很多時間可以觀察,有了這功能,要做簡單的梗圖、個人設計...速度會加快很多,步驟也會簡單很多,現在就已經讓人很期待這功能了。(這功能在iOS、iPadOS跟macOS都會上線)

~

~